Datenschutz im Homeoffice: Diese Fehler passieren täglich

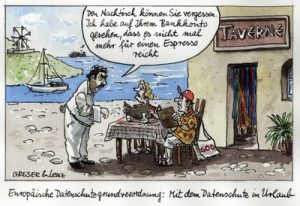

Kaffee aus der eigenen Küche, Videocall in Jogginghose, Katze auf dem Laptop. Das alles ist schön und gut, aber wie sieht es mit dem Datenschutz im Homeoffice aus? Das ist kein Thema, bei dem Unternehmen einfach mal ein Auge zudrücken können, aber dennoch passieren täglich Fehler, die niemand so richtig auf dem Schirm hat. Teuer können sie trotzdem werden – das Bußgeld kennt keine Homeoffice-Ausnahme.

Kein Regelwerk, kein Schutz

In meiner beruflichen Praxis stelle ich immer wieder fest, dass viele Unternehmen keine betriebliche Regelung zum Homeoffice und zum Umgang mit personenbezogenen Daten außerhalb des Büros haben. Es gibt keine Betriebsvereinbarung, keine Homeoffice-Richtlinie, kein Hinweis auf die datenschutzrechtlichen Pflichten der Mitarbeiter. Damit fehlt sowohl die organisatorische Grundlage als auch die Grundlage für Art. 5 und Art. 32 DSGVO. Diese besagen, dass Daten durch geeignete technische und organisatorische Maßnahmen geschützt werden müssen. Diese Maßnahmen müssen logischerweise irgendwo niedergeschrieben sein.

Wer Datenschutz im Homeoffice nicht regelt, überlässt ihn dem Zufall. Klingt das für Sie nach einer guten Lösung? Wohl eher nicht.

Das Privatgerät: Praktisch, aber problematisch

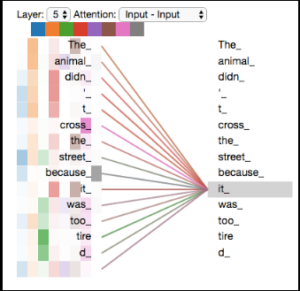

Kommt Ihnen das bekannt vor? „Ich nehme einfach meinen privaten Laptop, der ist eh schneller.“ Das klingt pragmatisch, ist datenschutzrechtlich aber ein Minenfeld. Auf privaten Endgeräten fehlen in aller Regel Sicherheitsmaßnahmen, die zentral sind für Unternehmen wie ein Mobile Device Management (MDM), Festplattenverschlüsselung nach Unternehmensstandard oder automatische Sicherheitsupdates. Dafür vermischen sich berufliche und private Daten. Ein gefundenes Fressen für Aufsichtsbehörden und Cybercriminelle.

Das bedeutet: Personenbezogene Daten – Kunden-, Mitarbeiter- und Bewerberdaten – haben auf privaten Geräten nichts zu suchen. Der sicherste Weg ist, betriebliche Endgeräte zu stellen und die private Nutzung im Arbeitsvertrag zu verbieten. Das schließt auch Handys ein.

Die Wohnung ist kein Datentresor

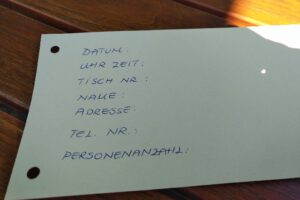

Noch so ein Klassiker ist der Mitarbeiter, der seinen Arbeitsplatz am Küchen- oder Esstisch eingerichtet hat. Der Partner schmiert sich ein Brot und erfährt gleichzeitig, warum Kollege Müller abgemahnt wird. Wunderbar.

Wer mit vertraulichen Daten arbeitet, braucht im Idealfall einen abschließbaren Raum. Wenn das nicht möglich ist, sollte der Arbeitsplatz zumindest nicht gleichzeitig Durchgangszone, Esszimmer und Spielfläche sein.

Und was ist mit den Unterlagen? Ein abschließbarer Schrank ist eine datenschutzrechtliche Mindestanforderung, sobald physische Dokumente mit personenbezogenen Daten mit nach Hause wandern. Und ja, das gilt auch für den Posteingang. Wer Mahnbescheide, Verträge oder Bewerbungsunterlagen ins Homeoffice mitnimmt und diese offen ablegt, verstößt gegen Art. 5 I lit. f) DSGVO. Das passiert zwar ohne böse Absicht, ist aber trotzdem nicht erlaubt.

Firmenunterlagen gehören nicht ins Altpapier

Da das seit langem prophezeite papierlose Büro noch auf sich warten lässt, landen viele Firmenunterlagen auch in Papierform im Homeoffice. Doch was passiert, wenn diese nicht mehr benötigt werden? Der einfache Weg ist häufig: zweimal durchreißen und dann ab ins Altpapier. Auf die Gefahr hin, dass ich mich wiederhole: Auch das verstößt gegen Art. 5 I lit. f) DSGVO. Für die Aktenvernichtung ist ein datenschutzkonformer Schredder oder eine versiegelte Datentonne zu verwenden. Wer das nicht zu Hause hat, muss den „Papiermüll“ wohl oder übel mit ins Büro nehmen und ihn dort DSGVO-konform entsorgen.

Eine Überprüfung muss möglich sein

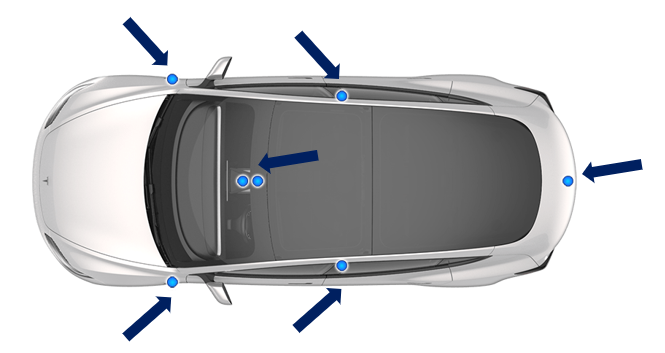

Zu guter Letzt stellt sich die Frage, wer die Einhaltung des Datenschutzes im Homeoffice eigentlich überprüft? Die Antwort ist klar: Das sollte der Arbeitgeber tun. Er haftet in der Regel ja auch für Datenschutzverstöße.

Nun darf der Arbeitgeber natürlich nicht einfach so die privaten Räumlichkeiten eines Mitarbeiters betreten, diese sind durch das Grundrecht auf Unverletzlichkeit der Wohnung gemäß Art. 13 GG geschützt. Deshalb ist zwingend eine schriftliche Vereinbarung zwischen dem Arbeitgeber und dem im Homeoffice arbeitenden Mitarbeiter erforderlich, die den Zutritt für arbeitsrelevante Themen regelt. Sie ist die Grundlage für die Homeoffice-Richtlinie.

Neben der Überprüfung der Einhaltung des Datenschutzes hilft die Vereinbarung im Zweifel übrigens auch dabei, dass alle Arbeitsmaterialien im Falle einer Kündigung zurückgeholt werden können. Auch ein Aspekt, den viele vergessen.

Datenschutz im Homeoffice gezielt angehen – die wichtigsten Sofortmaßnahmen

Datenschutz im Homeoffice ist kein Hexenwerk. Es gibt klare Spielregeln und die sind einzuhalten. Die wichtigsten Sofortmaßnahmen sind:

- Vereinbarung mit Mitarbeitern über Zutritt der privaten Räumlichkeiten schließen.

- Homeoffice-Richtlinie erstellen und alle Mitarbeiter nachweislich darüber informieren.

- Nur betriebliche Endgeräte mit aktueller Verschlüsselung und Sicherheitssoftware für die Arbeit mit personenbezogenen Daten zulassen.

- Physische Unterlagen ausschließlich in dringenden Fällen und mit klarer Rückgabepflicht ins Homeoffice mitnehmen.

- Abschließbare Aufbewahrung für Dokumente sicherstellen.

- Bildschirm bei Verlassen des Arbeitsplatzes sperren.

- Telefonate und Videocalls mit vertraulichem Inhalt niemals im Beisein Dritter führen.

- Mitarbeiter regelmäßig zum Thema Datenschutz schulen.

Fazit: Es besteht Handlungsbedarf

Datenvorfälle im Homeoffice unterliegen derselben Meldepflicht wie Vorfälle im Büro. Es braucht also klare organisatorische Entscheidungen und den Willen, diese auch durchzusetzen. Wer den Datenschutz im Homeoffice ignoriert, riskiert Bußgelder nach Art. 83 DSGVO und einen Vertrauensverlust von Kunden und Mitarbeitern – und der lässt sich nicht so einfach wegpatchen.

Sie wissen nicht, ob Ihr Homeoffice-Setup datenschutzkonform ist? Eine kurze Bestandsaufnahme zeigt schnell, wo der Schuh drückt – sprechen Sie mich gerne direkt an.

Oder wollen Sie lieber strukturiert beim Thema Datenschutz und IT-Sicherheit vorgehen? In meinen Seminaren zeige ich, worauf Unternehmen achten müssen. Alle Themen und Termine finden Sie unter cheyenne-IT.de/seminare.